Intégration de Données avec Pentaho

Nov 2025Création d'un pipeline ETL avec Pentaho Data Integration pour consolider et nettoyer des données environnementales, en appliquant une logique métier stricte.

Contexte et Enjeux : Découverte de Pentaho

Dans le vaste domaine de la data, on distingue généralement plusieurs types d’outils d’intégration de données. Si le marché est aujourd’hui dominé par des solutions comme Talend ou Dataiku, il existe des outils plus anciens mais extrêmement robustes comme Pentaho Data Integration (PDI). Après avoir suivi un atelier sur l’intégration de données, j’ai voulu tester Pentaho comme alternative à Talend Open Studio. Bien que l’outil puisse paraître austère au premier abord, je l’ai trouvé redoutablement efficace et pertinent pour les phases de pré-nettoyage et d’intégration.

Comme à mon habitude, j’ai accompagné mon apprentissage technique d’une problématique métier concrète. J’ai simulé le cas d’une entreprise internationale spécialisée dans le développement durable. Avant d’ouvrir de nouvelles agences stratégiques en Europe, cette entreprise souhaite analyser l’état de la pollution de l’air dans quatre pays cibles : la France, l’Espagne, l’Italie et l’Allemagne.

Ma mission était claire : collecter, traiter et consolider les données de pollution et socio-économiques pour produire un tableau de bord décisionnel (via Tableau) permettant d’identifier les zones les plus polluées et leur évolution dans le temps.

Recherche et Collecte des Données

La première étape de ce projet a consisté à sourcer la donnée. Pour que l’analyse soit complète, il me fallait des indicateurs variés, tous extraits au format CSV :

- Indicateurs de pollution : PM2.5, NO2, O3.

- Indicateurs climatiques : Émissions de CO2 par habitant.

- Indicateurs socio-économiques : Part de la population urbaine, PIB par habitant.

- Données géographiques : Villes, latitudes et longitudes pour la cartographie.

J’ai dû consolider ces informations à partir de multiples sources fiables (Our World in Data, World Bank, Kaggle, etc.). Cependant, c’est lors de la phase de préparation de ces fichiers que j’ai été confronté à un véritable enjeu de conception.

Le Cœur du Projet : Connaissance Métier vs Logique Métier

Lors de la définition de mon processus de nettoyage, j’ai eu un moment de réflexion (un véritable “stop”). Au-delà du nettoyage technique classique (suppression des doublons, gestion des valeurs nulles, formatage des chaînes de caractères), je devais nettoyer mes données en respectant le besoin de l’entreprise. C’est ici que j’ai compris la distinction fondamentale entre deux concepts :

- La connaissance métier : C’est la compréhension des contraintes réelles du domaine ou de l’entreprise. Dans mon cas, la connaissance métier stipulait que l’analyse ne portait que sur 4 pays précis (France, Espagne, Italie, Allemagne), sur une période temporelle stricte allant de 2010 à 2023, et qu’une donnée sans coordonnées géographiques (latitude/longitude) était inutile pour décider de l’emplacement d’une agence.

- La logique métier (ou Business Logic) : C’est l’application technique et informatique de cette connaissance. C’est le fait de traduire ces contraintes en règles de nettoyage algorithmiques dans le pipeline.

Il ne servait à rien d’intégrer des données mondiales ou datant de 1990. J’ai donc appris à implémenter cette logique métier directement dans Pentaho pour filtrer drastiquement mon jeu de données en amont, garantissant ainsi un Dataset final parfaitement aligné avec l’objectif stratégique.

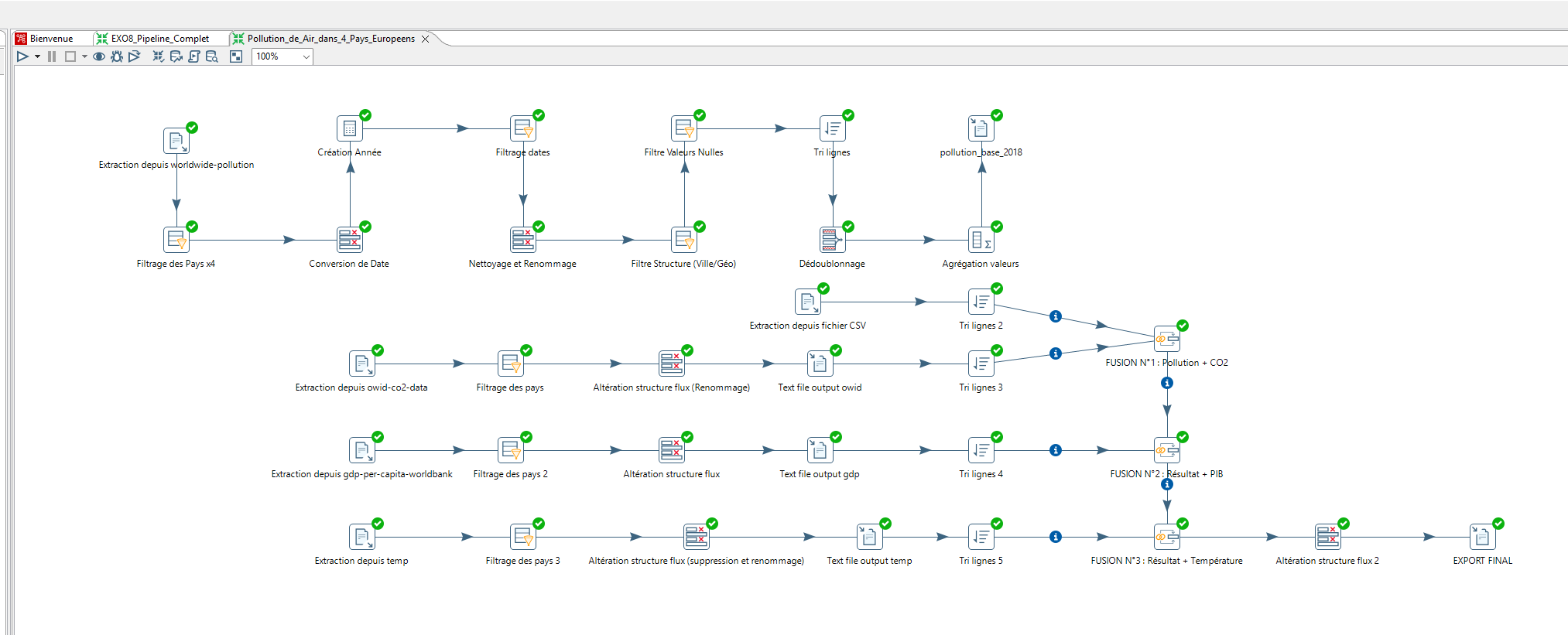

Le Pipeline de Traitement sous Pentaho

Le traitement a été réalisé en flux continu dans Pentaho, de l’extraction jusqu’à l’export, en gérant de multiples jointures.

Étape 1 : Importation des Données

J’ai chargé les différents fichiers via le step CSV File Input. Il a fallu configurer rigoureusement les délimiteurs (virgules ou points-virgules selon les sources) et typer les données (String pour les pays, Integer pour les années, Number pour les métriques de pollution).

Étape 2 : Nettoyage et Normalisation

Cette étape a été appliquée individuellement à chaque flux avant toute tentative de fusion :

- Renommage (

Select Values) : Harmonisation des clés de jointure (transformer “Entity” en “Country”, “Year” en “Annee”). - Nettoyage de texte (

String Operations) : Application de la fonction Trim sur les noms de pays et les codes pour éviter que des espaces parasites ne fassent échouer les jointures. - Filtrage métier (

Filter Rows) : C’est ici que ma logique métier est intervenue. J’ai supprimé les lignes sans Code Pays (les agrégats régionaux), exclu les années hors du scope 2010-2023, et filtré les lignes avec des valeurs géographiques nulles. - Dédoublonnage (

Unique Rows) : Suppression des doublons stricts basés sur la clé composite {Pays + Annee}.

Étape 3 : Fusion des Données (Merging)

Pour consolider tous ces indicateurs épars dans une seule table unifiée, j’ai utilisé l’année et le code pays comme facteurs de jointure.

- Tri (

Sort Rows) : Dans Pentaho, un tri ascendant sur les clés de jointure est techniquement obligatoire avant de fusionner. - Jointures en cascade (

Merge Join) : J’ai effectué des Inner Joins progressifs (Flux CO2 + Flux PIB -> Temp1 ; Temp1 + Flux Urbanisation -> Temp2 ; etc.) jusqu’à obtenir mon Dataset final complet.

Étape 4 : Export et Visualisation

Le résultat a été généré via un Text File Output (au format CSV, encodage UTF-8). Ce fichier propre et unifié a ensuite été importé dans Tableau Desktop pour créer les visualisations et le classement final des pays les plus pollués, répondant ainsi parfaitement à la commande de l’entreprise.

Récapitulatif des apprentissages

- Maturité Analytique : Compréhension et application concrète de la différence entre la connaissance métier (le besoin) et la logique métier (l’implémentation des filtres).

- Maîtrise d’un outil ETL historique : Prise en main de Pentaho Data Integration, gestion des flux parallèles, des étapes de transformation (

String Operations,Select Values) et des contraintes de tri avant jointure. - Consolidation de données hétérogènes : Capacité à unifier des sources disparates (fichiers aux délimiteurs et formats différents) via des clés de jointure composites (Pays + Année).

- Vision bout-en-bout : Pilotage du cycle complet de la donnée, du sourcing brut sur Internet jusqu’à l’alimentation d’un outil de Business Intelligence (Tableau).

Annexe : Sources de Données

Indicateurs de pollution (PM2.5, PM10, NO₂, O₃) :

Indicateurs climatiques et environnementaux :

Indicateurs socio-économiques & Géographiques :